草根影響力新視野 編譯 鍾藝

你是否嘗試過,通過識別陌生人的聲音,在大腦裡構建出這個人的形象?人工智慧(AI)現在已被證實可以做到這一點 僅使用簡短的剪輯音頻就能生成人臉的數字圖像。

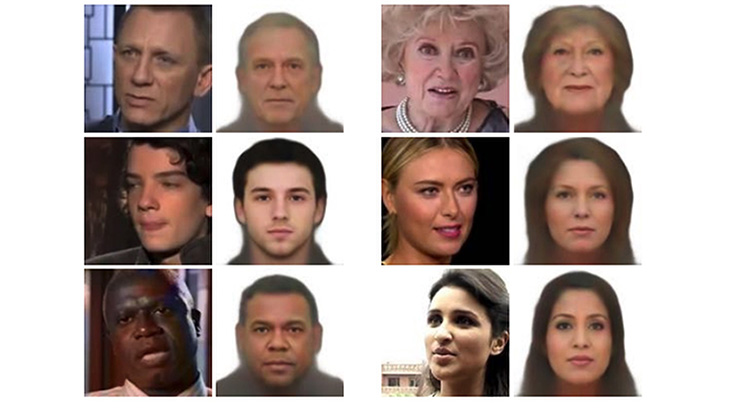

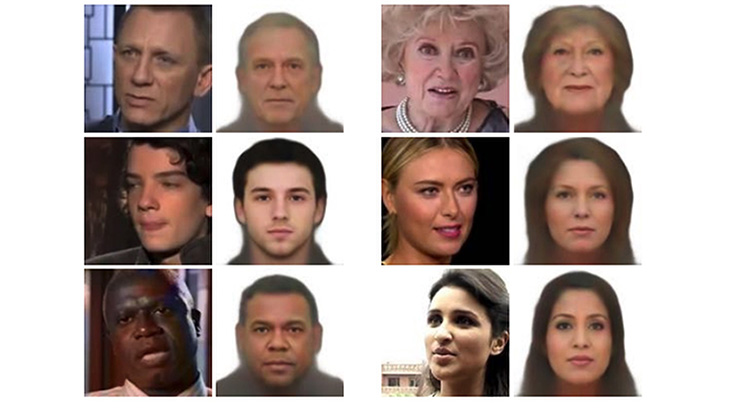

科學家對名為Speech 2Face的神經網路計算機(其工作原理類似於人類大腦的思考方式)進行了數量龐大的視頻訓練,在數百萬視頻中有超過100,000名不同的人在說話。研究人員在研究報告中寫道,Speech 2Face從這些海量數據中發現了人類聲音和某些身體特徵之間的聯繫。基於此,Speech 2Face可以使用音頻來模擬呈現與聲音相匹配的面容。

科技快速進步往往也會讓人不安,慶幸的是,目前Speech 2Face還不能僅通過聲音就精準模擬出相對應的人具體長什麼樣子。研究作者表示,現階段Speech 2Face能從語音中識別出來一些共性特徵,比如性別、年齡、種族等。換言之,目前的AI技術只能呈現出一個大致的輪廓性樣貌,不會產生特定的精確個體畫像。

雖然Speech 2Face已經能通過聲音配備上一定的外貌輪廓,但其背後的AI演算法還需不斷精進,目前仍有一些bug未能得到處理。比如,當Speech 2Face聽到同一聲源的聲音變化時,它所識別出來的輪廓就會發生變化。舉個例子,當Speech 2Facee聽到一個亞洲男子說中文時,它所呈現的圖像為一張亞洲男性的臉,但如果此男子說英文,它所呈現的圖像就會變為白人的臉。除此以外,在性別識別也可能會有問題。目前,Speech 2Face將低音調的聲音與男性面部相關聯,將高音調聲音與女性面部相關聯。然而,Speech 2Face的受訓數據僅來自YouTube,數據源並不能代表整個世界人口,所以一旦出現低音調的女性,它的識別就會出錯。

Slate報導,如果一個人出現在YouTube視頻中,那麼他的樣子很快就會被納入此項研究的資料庫。舊金山互聯網安全公司Cloudflare的密碼學負責人Nick Sullivan就意外地發現他的臉成為了Speech 2Face受訓數據的一員。所以,這項研究背後的隱私數據安全問題也浮出水面。

資料來源:AI Listened to People’s Voices. Then It Generated Their Faces.