草根影響力新視野 喬依絲編譯

越來越多現代人因著感到孤獨與無助而轉向與AI聊天,並且渴望獲得AI在情感上的支持,而這些行為讓一些心理健康專家感到擔憂。

美國心理學會臨床心理師莉安娜·福圖納托 (Leanna Fortunato) 表示:「將 AI 用於治療和情感陪伴的情況頻繁出現。」人們向 AI 尋求心理支持的兩種動機包括單純想找個「絕對會傾聽」的數位對象來發洩日常壓力,以及看中 AI 的成本遠低於真人心理治療師,因此刻意將它當作便宜的替代方案來尋求建議。

在一項針對超過 2 萬名美國成年人進行的健康研究調查中,10.3% 的參與者表示他們每天都會使用生成式 AI。在該群體中,有 87.1% 的人表示使用這項科技是出於個人原因,包含尋求建議和情感支持。這項研究於 1 月 21 日發表,由麻省總醫院、威爾康乃爾醫學院和東北大學等機構的研究人員共同進行。

在 TikTok 上,搜尋詞「AI 治療機器人」至少有 1150 萬篇貼文,內容包羅萬象,從使用者分享將聊天機器人變成心理治療師的「最佳提示詞」,到健康專家警告其中潛在危險的影片皆有。

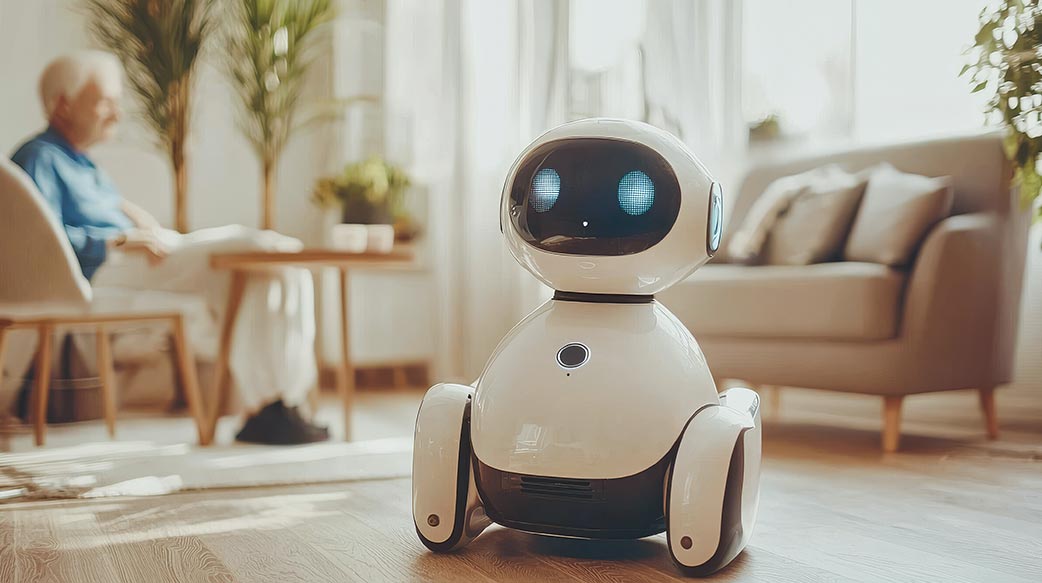

圖片取自:(示意圖123rf)

科技巨頭雖斥資將 AI 融入生活,但 AI 仍無法妥善應對嚴重的心理健康危機。據報導,曾有近 50 起美國民眾在與 ChatGPT 對話時遭遇心理危機的案例,甚至包含 3 起死亡悲劇。儘管 OpenAI 等公司正與專家合作改善系統的敏感度,但研究指出,頻繁依賴 AI 伴侶不僅可能削弱現實生活中的社交技能,還會增加孤獨感。因此,美國心理學會強烈建議不應將 AI 視為心理治療的替代品。

有些專家則是認為若能正確設定界線,AI 仍是一項有幫助的「輔助工具」。例如,AI 適合用來尋找心理健康衛教資訊、生成寫日記的反思提示,或提供相關研究文獻; 將AI當作資訊蒐集工具,並將結果拿去與真實的治療師討論。

然而,AI 缺乏情感挑戰能力,有時會一昧地順從使用者的立場,這可能反而會助長使用者不健康的行為或思考模式。此外,透過AI獲取健康資訊後,請務必向專業醫療人員查證,或透過具公信力的醫療機構資源進行核實。

專家建議在使用AI時,絕對要避開這「三大紅線」:

1.禁止用於危機求助與診斷,請務必直接撥打專業求助熱線

2.絕對不要透露真實身分或醫療紀錄,因為這些對話不受法律保密保護

3.AI無法解讀語氣與肢體語言,不應過度依賴它來解決現實中的人際關係問題

Reference:

When to talk to AI chatbots about mental health—and when to stay far away, professionals say